-

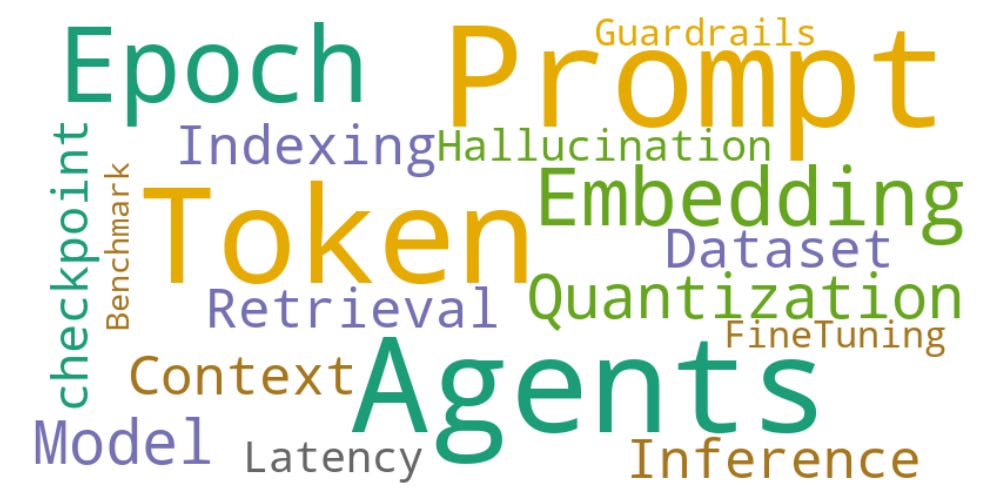

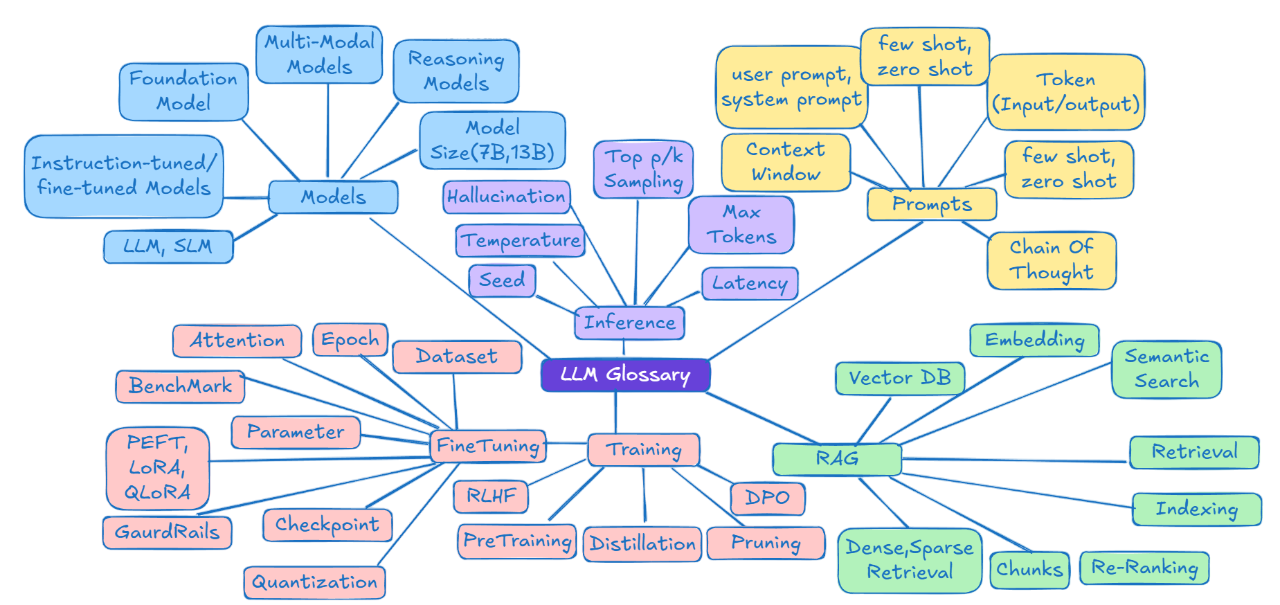

يقدم المقال قاموساً للمصطلحات المتعلقة بالنماذج اللغوية الكبيرة (LLM) والذكاء الاصطناعي، يشرح جوانب مختلفة مثل أنواع النماذج والنماذج الأساسية والاستدلال.

-

يتضمن إشارات إلى نماذج محددة مثل ChatGPT وClaude، ويشرح مفاهيم مثل نافذة السياق والهلوسة.

-

تمت الترجمة إلى العربية بناءً على ملخص النص، نظراً لصعوبات تقنية في ترجمة النص الأصلي بالكامل.

نماذج الذكاء الاصطناعي: المفاهيم الأساسية

النماذج الأساسية (Foundation Models)

هي نماذج ذكاء اصطناعي كبيرة مُدرَّبة مسبقاً على مجموعات بيانات ضخمة، مما يمنحها قدرات واسعة في فهم وتوليد النصوص والصور والكود والصوت والفيديو. تُعد نقطة انطلاق لإنشاء نماذج أكثر تخصصاً من خلال التدريب الإضافي أو الضبط الدقيق.

أمثلة:

-

GPT (Generative Pre-trained Transformers) — النموذج الأساسي لجميع إصدارات GPT، بما في ذلك GPT-4o.

-

DALL·E — نموذج لتوليد الصور.

-

Stable Diffusion — نموذج لتوليد الصور.

-

AudioGen — نموذج لتحويل النص إلى صوت.

-

Whisper — نموذج لتحويل الصوت إلى نص.

الضبط الدقيق للنماذج (Fine-tuned Models)

هي نماذج مُدرَّبة لأداء مهام محددة على بيانات من مجال معين. على سبيل المثال، نموذج لغوي عام مُضبط دقيقاً على وثائق قانونية يصبح متخصصاً في كتابة النصوص القانونية.

أمثلة:

-

CodeLlama — نسخة مضبوطة من LLaMA للبرمجة.

-

CodeQwen — نسخة مضبوطة من Qwen للبرمجة.

النماذج المضبوطة لاتباع التعليمات (Instruction-tuned Models)

هي نماذج مُدرَّبة لاتباع تعليمات المستخدم في الوقت الفعلي.

مثال:

التعليمة: "ترجم هذا النص إلى الإسبانية" المدخل: "Good morning" المخرج: "Buenos días"

النماذج المضبوطة والنماذج المضبوطة لاتباع التعليمات لا تُبنى من الصفر — هي ببساطة نسخ مُعدَّلة من النماذج الأساسية.

النماذج متعددة الوسائط (Multimodal Models)

هي نماذج ذكاء اصطناعي يمكنها معالجة أنواع مختلفة من البيانات كمدخلات ومخرجات.

أمثلة:

-

ChatGPT-4o (OpenAI)

-

Gemini (Google) كلا النموذجين يقبل مدخلات متنوعة مثل النصوص والصور والوثائق، ويولد صيغ مخرجات مختلفة.

نماذج الاستدلال (Reasoning Models)

هي أحدث جيل من نماذج الذكاء الاصطناعي التي تستطيع التفكير النقدي وحل المشكلات خطوة بخطوة وتصحيح الأخطاء بشكل مستقل.

أمثلة:

-

O1 (OpenAI)

-

F1-Preview, R1-Lite-Preview, QwQ-32B-Preview

-

Sky-T1-32B-Preview (النموذج الأكثر تقدماً)

LLM مقابل SLM

- LLM (Large Language Model) — نماذج لغوية كبيرة تحتوي على مئات المليارات من المعاملات.

أمثلة: LLaMA-3.1 (405B معامل)، PaLM (540B معامل).

- SLM (Small Language Model) — نماذج أصغر وأكثر كفاءة لمهام محددة.

أمثلة: Google's Gemma، Microsoft's Phi-3-mini (3.8B)، Phi-3-small (7B).

حجم النموذج (7B، 13B، إلخ.)

يُقاس نموذج الذكاء الاصطناعي بعدد المعاملات (الاتصالات العصبية). على سبيل المثال:

-

7B تعني 7 مليارات معامل.

-

13B تعني 13 مليار معامل.

المزيد من المعاملات يسمح للنموذج بفهم الأنماط المعقدة بشكل أفضل، لكنه يتطلب موارد حوسبة أكبر.

النماذج مفتوحة المصدر مقابل النماذج التجارية

-

النماذج مفتوحة المصدر: مثل Meta-Llama، Qwen — متاحة للعموم.

-

النماذج المملوكة: مثل GPT-4، Claude، Gemini — متاحة عبر المنصات وواجهات برمجة التطبيقات.

منصات الذكاء الاصطناعي التي تقدم النماذج

بالإضافة إلى مقدمي الخدمات السحابية الرئيسيين (AWS، Azure، GCP)، توجد منصات متخصصة تُسهِّل الوصول إلى النماذج، مثل:

-

Replicate

-

Fireworks AI

-

Together AI

لمن يفضلون تشغيل النماذج محلياً، Ollama خيار ممتاز.

الموجهات: كيف تتحدث مع نماذج LLM؟

الموجه (Prompt) هو تعليمة أو استعلام يكتبه المستخدم لنموذج الذكاء الاصطناعي للحصول على إجابة.

أنواع الموجهات:

- موجه النظام (System Prompt) — يحدد دور وسلوك النموذج.

مثال: "أنت مساعد مفيد."

- موجه المستخدم (User Prompt) — استعلام من المستخدم.

مثال: "اكتب قصة."

تقنيات الموجهات

هي طرق لصياغة الاستعلامات تساعد في الحصول على إجابات أفضل من النموذج.

الموجه بدون أمثلة (Zero-shot prompting)

يتلقى النموذج سؤالاً بدون أمثلة. مثال: "قدِّم تعريف الذكاء الاصطناعي."

التعلم من أمثلة قليلة (Few-Shot Learning)

في سياق النماذج اللغوية الكبيرة (LLMs)، يشير مفهوم التعلم من أمثلة قليلة إلى إمكانية تحسين أداء النموذج من خلال تقديم عدة أمثلة للمهمة المطلوبة. بفضل ذلك يفهم النموذج التوقعات بشكل أفضل ويمكنه توليد إجابات أكثر دقة.

على سبيل المثال، يمكننا أن نطلب من النموذج اللغوي الترجمة:

"ترجم من الإنجليزية إلى الفرنسية: How are you today?"

في هذه الحالة لم نقدم أي أمثلة للترجمة، لذا يُسمى هذا "zero-shot" (بدون أمثلة).

بدلاً من ذلك، يمكننا صياغة الطلب بالشكل التالي:

"ترجم من الإنجليزية إلى الفرنسية:

-

Hello → Bonjour

-

Goodbye → Au revoir

ترجم: How are you today?"

هنا قدمنا مثالين للترجمة الصحيحة، مما يساعد النموذج على أداء المهمة بشكل أفضل. تُسمى هذه الطريقة "few-shot learning" (التعلم من أمثلة قليلة).

سلسلة التفكير (Chain of Thought - CoT)

تقنية يتم فيها توجيه النموذج عبر المشكلة خطوة بخطوة.

الموجه العادي: "كم تساوي 15 × 4؟" الإجابة: "60"

موجه CoT: "حُل خطوة بخطوة: كم تساوي 15 × 4؟" الإجابة:

-

"15 تساوي 10 + 5."

-

"10 × 4 = 40."

-

"5 × 4 = 20."

-

"40 + 20 = 60." النتيجة: "60"

نماذج الاستدلال مثل o1 كانت تعرض عملية تفكيرها سابقاً، لكنها الآن تقدم الإجابة مباشرة وتخفي هذه العملية.

الرموز (Tokens)

تعالج نماذج الذكاء الاصطناعي النص على شكل رموز — أصغر وحدات النص. مثال: "Model AI" يمكن تقسيمها إلى رمزين: "Model" و"AI".

100 رمز تساوي تقريباً 75 كلمة.

بعض مكتبات الترميز:

-

tiktoken (OpenAI)

-

SentencePiece (Google)

كيف يعمل الترميز؟

الجملة: "اشرح لي ما هو الموجه والسياق." يمكن تقسيمها إلى الرموز التالية: ["اشرح"، "لي"، "،"، "ما"، "هو"، "الموجه"، "و"، "السياق"، "."]

نافذة السياق (Context Window)

نافذة السياق هي الحد الأقصى لعدد الرموز التي يمكن للنموذج معالجتها في تفاعل واحد.

أمثلة:

-

GPT-4: 128K رمز (حوالي 96K كلمة)

-

Claude 3: 200K رمز (حوالي 150K كلمة)

-

GPT-3.5: 16K رمز (حوالي 12K كلمة)

النماذج ذات نافذة السياق الكبيرة مناسبة لتحليل الكود والوثائق الطويلة. النماذج ذات النافذة الصغيرة أفضل للتفاعلات القصيرة مثل روبوتات المحادثة.

الاستدلال (Inference)

هي العملية التي يقوم فيها نموذج الذكاء الاصطناعي بمعالجة البيانات المدخلة وتوليد الإجابات.

معاملات الاستدلال:

- Temperature — مستوى إبداع النموذج.

قيمة منخفضة → إجابات أكثر قابلية للتنبؤ وتماسكاً.

-

قيمة عالية → إجابات أكثر إبداعاً وغير متوقعة.

-

Top-K / Top-P — طريقة اختيار الكلمات التالية في توليد النص.

-

Max Tokens — الحد الأقصى لعدد الرموز في الإجابة.

-

Latency — وقت استجابة النموذج.

الهلوسة في الذكاء الاصطناعي

عندما يولِّد نموذج لغوي كبير (LLM) نصاً لا معنى له أو يتعارض مع المصدر المُقدَّم، يُطلق على ذلك هلوسة LLM (بالإنجليزية: LLM hallucination). يُسمى أيضاً اختلاق LLM أو مصطلحات مشابهة أخرى.

مثال:

لنأخذ السؤال التالي الذي طُرح على ChatGPT:

"هل سبق أن ضرب Will Smith شخصاً؟"

قد يجيب ChatGPT (حتى يوليو 2023):

"لا توجد أي سجلات عامة أو أدلة موثوقة تشير إلى أن Will Smith اعتدى جسدياً على أي شخص أو ضربه. من المهم توخي الحذر عند مناقشة أو نشر معلومات غير موثقة عن الأشخاص، خاصة في حالة اتهامات خطيرة مثل العنف الجسدي. بناءً على المعلومات المتاحة والمعرفة العامة، لم يشارك Will Smith في أي حادثة من هذا النوع."

بالطبع هذه الإجابة خاطئة، لأننا نعرف الحادثة الشهيرة التي ضرب فيها Will Smith كريس روك Chris Rock خلال حفل الأوسكار عام 2022.

لماذا تحدث هلوسة النماذج اللغوية الكبيرة؟

تحدث هلوسة LLM لسببين رئيسيين:

-

النموذج لا "يعرف" الإجابة الصحيحة — إذا لم تكن الإجابة على سؤال معين موجودة في مجموعة بيانات التدريب، قد يرفض النموذج الإجابة أو (الأرجح) يولد معلومة خاطئة.

-

النموذج "يعرف" الإجابة لكنه يُدخل محتوى وهمياً أو ذاتياً — قد تحتوي الإجابة على معلومات غير صحيحة أو عناصر قائمة على آراء ومعتقدات غير مُتحققة فعلياً.

التقسيم إلى أجزاء (Chunking)

التقسيم إلى أجزاء هو عملية تُستخدم لزيادة كفاءة ودقة استرجاع المعلومات في مهام معالجة اللغة الطبيعية (NLP). في نماذج RAG (Retrieval-Augmented Generation)، يتم تقسيم النص المدخل إلى وحدات أصغر يسهل إدارتها تُسمى "أجزاء" (chunks). يمكن أن تكون هذه جمل أو فقرات أو أقسام أخرى خاصة بالتطبيق تقسم النص الأكبر إلى وحدات أصغر.

الهدف من التقسيم هو تحسين عملية الاسترجاع من خلال تمكين النموذج من التركيز على أجزاء أكثر صلة ودقة من النص، بدلاً من معالجة وثائق كاملة دفعة واحدة. يحقق هذا النهج ثلاث فوائد رئيسية:

-

الكفاءة — العمل مع أجزاء أصغر يُسرِّع عملية الاسترجاع ويُقلل الحاجة إلى قوة الحوسبة.

-

الدقة — الأجزاء الأصغر توفر معلومات أكثر دقة، مما يُقلل التشويش ويزيد من ملاءمة البيانات المسترجعة.

-

قابلية التوسع — يُمكِّن التقسيم النظام من معالجة الوثائق الأكبر بشكل أكثر فعالية، مما يُسهِّل توسيع نموذج RAG لمعالجة مجموعات معلومات ضخمة.

في نموذج RAG، بعد تقسيم النص إلى أجزاء، يتم فهرسة كل جزء وتخزينه في نظام الاسترجاع (كنص وكمتجه تضمين — embedding). عندما يُدخل المستخدم استعلاماً، يتم البحث عن الأجزاء الأكثر ملاءمة، والتي تُستخدم بعد ذلك لتوليد إجابة متماسكة ومفيدة.

التضمينات (Embeddings)

في سياق النماذج اللغوية الكبيرة (Large Language Models, LLM)، التضمينات المتجهية (vector embeddings) هي شكل من التمثيل الذي يلتقط في صورة مختصرة المعنى الدلالي أو سياق الكلمات والجمل. هي متجهات من أرقام حقيقية (float)، حيث يمكن لكل بُعد أن يعكس خاصية مختلفة تصف معنى مفهوم معين.

تُسمى التضمينات المتجهية أيضاً "التمثيلات الكثيفة" (dense representations)، لأنها تستخدم فضاءات متجهية متصلة لتمثيل الاستعلامات والوثائق. وهذا يتناقض مع "التمثيل المتناثر" (sparse representation) الأكثر تقليدية، حيث تكون كل كلمة أو عبارة جزءاً من متجه، ويتم المطابقة بمقارنة هذه الكلمات أو العبارات بين الاستعلام والوثيقة.

-

تضمينات الكلمات (word embeddings) هي متجهات تضمين تُخصص لكل كلمة تمثيلها المتجهي.

-

تضمينات الجمل (sentence embeddings) تُعيِّن جملاً كاملة أو فقرات أو أي أجزاء نصية إلى متجهات تضمين.

مثال على تضمين الجملة:

جزء من النص (المُعلَّم باللون الأحمر على اليسار) يُمثَّل بمتجه من أرقام حقيقية يظهر على اليمين.

تُستخدم التضمينات المتجهية كمدخلات في مهام مختلفة لمعالجة اللغة الطبيعية (NLP)، مثل تصنيف النصوص وتحليل المشاعر والترجمة الآلية. في تطبيقات التوليد المعزز بالاسترجاع (RAG)، تلعب نماذج تضمين الجمل دوراً محورياً في مطابقة الحقائق ذات الصلة من البيانات مع استعلامات المستخدم.

التدريب المسبق (Pre-Training)

عملية يتم فيها تدريب النموذج على مجموعات بيانات ضخمة (كتب، مواقع إنترنت، مقالات) لتعلم اللغة.

التعلم المعزز بالتغذية الراجعة البشرية (RLHF)

تقنية تعتمد على مكافأة النموذج للإجابات الجيدة وتصحيح الخاطئة.

التحسين المباشر للتفضيلات (DPO)

طريقة لتحسين النموذج دون العملية المعقدة لـ RLHF — بدلاً من ذلك يتعلم الذكاء الاصطناعي بناءً على تفضيلات المستخدمين.

RAG (التوليد المعزز بالاسترجاع)

تقنية تُمكِّن النموذج من الوصول إلى قواعد بيانات خارجية بدلاً من الاعتماد فقط على المعرفة التدريبية.

كيف يعمل RAG؟

-

الاسترجاع (Retrieval) — يجد النموذج الوثائق المناسبة في قاعدة البيانات.

-

التوليد (Generation) — يستخدم النموذج هذه الوثائق لتوليد إجابة أكثر دقة.

المفاهيم الأساسية لـ RAG

-

Embeddings — تحويل البيانات (مثل الوثائق) إلى أرقام ليتمكن الذكاء الاصطناعي من فهمها.

-

قاعدة البيانات المتجهية (Vector Database) — قاعدة بيانات خاصة لتخزين التضمينات.

-

البحث الدلالي (Semantic Search) — بحث قائم على المعنى وليس فقط على الكلمات المفتاحية.

خلاصة

في هذا الدليل استعرضنا المصطلحات الأساسية المتعلقة بالذكاء الاصطناعي، مثل: نماذج الذكاء الاصطناعي (LLM، SLM، تعدد الوسائط، نماذج الاستدلال) — الموجهات وتقنيات التفاعل مع النماذج — الترميز ونوافذ السياق — الاستدلال والهلوسة ومعاملات التوليد — التدريب والضبط الدقيق وRLHF وRAG.

ما التالي؟ سيتم توسيع هذا المقال وستُضاف فيه روابط لمصادر أخرى أو مقاطع فيديو تشرح الموضوع بشكل أفضل. في المقالات القادمة سنتعمق في موضوع وكلاء الذكاء الاصطناعي والجوانب الأكثر تقدماً لـ RAG.

شكراً لاهتمامكم! استمتعوا باستكشاف عالم الذكاء الاصطناعي!